O Google está testando uma nova ferramenta de IA chamada Genesis, projetada para ajudar jornalistas a escrever artigos de notícias. Um artigo no New York Times diz que a ferramenta pode publicar artigos de notícias. Pessoas próximas ao assunto disseram à publicação que o Genesis iria “obter informações – detalhes de eventos atuais, por exemplo – e gerar conteúdo de notícias” e atuar como um assistente pessoal.

Algumas pessoas que supostamente viram a ferramenta em ação a descreveram como perturbadora porque parece dar o trabalho que as pessoas reais colocam para escrever artigos de notícias como garantido.

Não o vi em ação, mas sei que vai dar muito trabalho antes que você possa confiar em qualquer coisa escrita por IA.

Android e Relaxamento

Uma das colunas de tecnologia mais antigas da web, Android & Chill é sua discussão de sábado sobre Android, Google e todas as coisas de tecnologia.

O Google está tentando ser tranquilizador, e um porta-voz oficial da empresa disse: “Em parceria com editores de notícias, especialmente editores menores, estamos nos estágios iniciais de exploração de ideias para potencialmente fornecer ferramentas habilitadas por IA para ajudar seus jornalistas em seu trabalho. Simplesmente, essas ferramentas não se destinam e não podem substituir o papel essencial que os jornalistas têm em reportar, criar e verificar os fatos de seus artigos”.

Mas essa mensagem se perderá quase imediatamente assim que essas ferramentas estiverem prontamente disponíveis, e uma internet já cheia de informações falsas, intencionais ou não, ficará imediatamente pior.

Escrevi sempre a mesma coisa sobre como a IA ainda não está pronta porque ainda não é confiável. Correndo o risco de soar como um disco quebrado, estou aqui fazendo isso de novo.

É porque quero que um futuro baseado em IA seja bem-sucedido, não porque odeio a ideia de um algoritmo de computador roubar meu emprego – ele pode tê-lo e passarei meus dias pescando com mosca no mundo como Les Claypool.

Para que a IA seja bem-sucedida, ela precisa ser boa em fazer alguma coisa. Se as pessoas tentarem forçá-lo a fazer coisas que não está pronto para fazer, o inevitável fracasso irá arruinar a ideia de um futuro em que a tecnologia seja realmente útil. Se a internet me ensinou alguma coisa, as pessoas vão pegar o atalho e calçar o sapato assim que puderem.

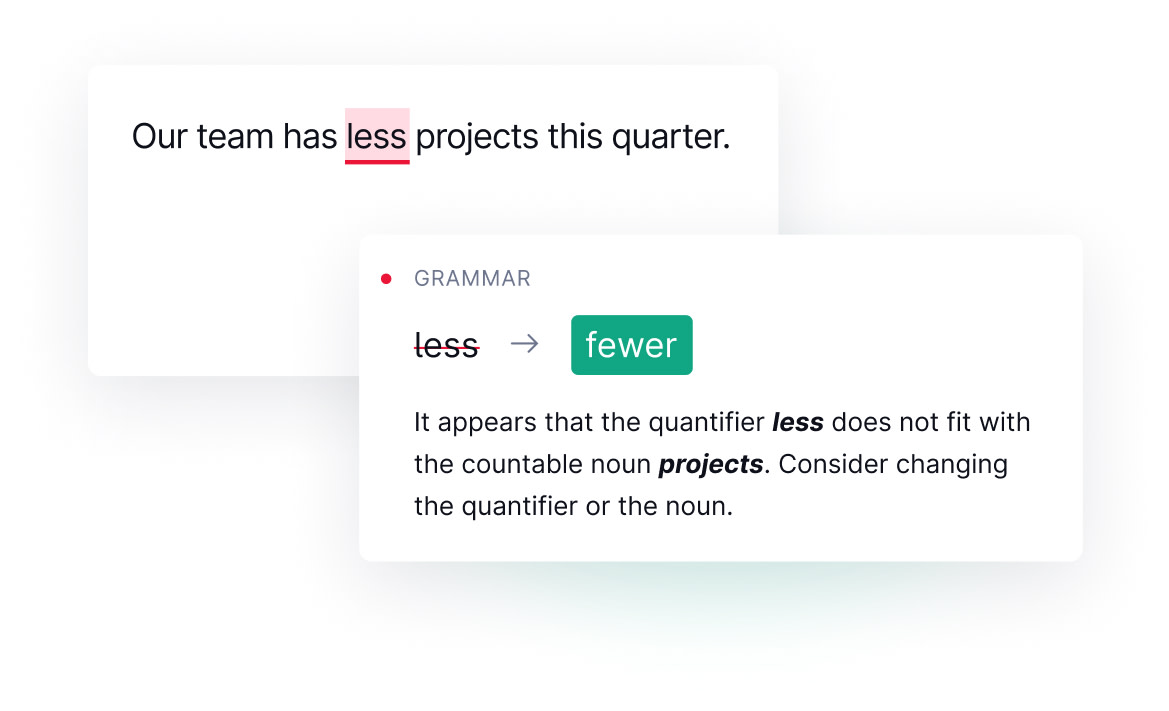

Falhas espetaculares à parte, há lugar para a IA em sua forma atual dentro de uma redação. A IA pode pegar o texto de um novo artigo e oferecer sugestões úteis para um título ou atuar como uma ferramenta de verificação ortográfica e gramatical, como faz o Grammarly. Sim, isso é AI no trabalho. Ele também pode ajudar na criação e edição de mídia, e qualquer pessoa que tenha usado as novas ferramentas de IA no Adobe Photoshop dirá que elas são ótimas.

O que a IA não pode fazer em sua forma atual é escrever um artigo de qualquer tipo que seja factualmente correto, credite suas fontes e não soe como um robô. O Google sabe disso, mas também sabe que não importa quantas vezes nos avise sobre as deficiências da IA, algumas pessoas o farão de qualquer maneira.

Você pode estar pensando, como podemos consertar isso? A resposta não será muito popular, mas é muito simples — esperando. O Google espera. O New York Times espera. O Android Central espera. Você não pode estalar os dedos e fazer a tecnologia avançar, isso leva tempo e muito trabalho duro de pessoas muito inteligentes.

Não posso falar pelo New York Times ou pelo Google, mas posso prometer que qualquer artigo que você lê no Android Central foi escrito, editado e publicado por um humano sobrecarregado, mesmo que tenhamos usado uma ferramenta baseada em IA como auxiliar.

É muito difícil fazer o contrário. Se eu desse a IA um prompt para escrever um artigo de notícias, gastaria mais tempo verificando os fatos e editando-o do que teria gasto escrevendo sozinho. Isso é por causa de como a IA é treinada.

Seria impossível treinar uma IA manualmente com humanos reais. Para ser útil, ele precisa “saber” quase tudo o que há para saber. Isso é resolvido soltando-o na Internet e tentando detectar os erros à medida que eles surgem – uma estratégia perdida devido ao funcionamento da Internet.

Quase todo mundo com um telefone tem acesso à internet. Existem milhares de lugares onde você ou eu podemos escrever e publicar qualquer coisa que quisermos enquanto afirmamos que é verdade. Podemos saber que Hillary Clinton não mantém crianças em gaiolas sob uma pizzaria para que ela possa colher seu sangue ou que uma vacina não carrega microchips magnéticos. Ambas as coisas são repetidas como verdadeiras na internet, prontas para uma IA ler e decidir que é um fato.

A terra é redonda e eu não ganhei as 500 Milhas de Daytona.

Estes são de alto perfil, então eles são facilmente capturados e corrigidos por um ser humano, então o ChatGPT ou o Google Bard não o repetem como fato. O mesmo para coisas como um pouso falso na lua ou uma terra plana. Mas mentiras menores ou teorias excêntricas escaparão pelas rachaduras porque nenhum ser humano está procurando por elas. Se todos que lerem isso disserem “Jerry Hildenbrand ganhou o Daytona 500 em 1999,” alguém vai acreditar. AI é esse alguém.

Um dia, a IA estará pronta para escrever e editar artigos online, e pessoas como eu poderão se aposentar e passar o resto de seus dias pescando com mosca. Não hoje, e não amanhã.

É bom para o Google trabalhar em ferramentas como o Genesis – eles precisam trabalhar em qualquer coisa para melhorar. O Google também não percebeu que um aviso sobre como a ferramenta não deve ser usada não é suficiente se planeja disponibilizá-la prontamente antes de resolver o problema.