ChatGPT é uma ferramenta incrível, uma maravilha moderna de inteligência artificial de linguagem natural que pode fazer coisas incríveis. Mas com grande poder vem uma grande responsabilidade, então o desenvolvedor do ChatGPT, OpenAI, colocou algumas salvaguardas para evitar que ele faça coisas que não deveria. Ele também tem algumas limitações com base em seu design, nos dados em que foi treinado e nas limitações absolutas de uma IA baseada em texto.

Existem, é claro, diferenças entre o que o GPT-3.5 pode fazer em comparação com o GPT-4, que está disponível apenas por meio do ChatGPT Plus. Algumas dessas coisas estão apenas em espera enquanto se desenvolve, mas há algumas coisas que o ChatGPT pode nunca ser capaz de fazer. Aqui está uma lista de 11 coisas que o ChatGPT não pode ou não fará. – por agora.

Não pode escrever sobre nada depois de 2021

O ChatGPT é construído treinando o modelo de linguagem nos dados existentes. Isso inclui postagens do Reddit, Wikipedia e até manuais de jogos de tabuleiro – sim, sério. Mas esses dados tinham que ter um ponto de corte em algum lugar e, para ChatGPT, é 2021. Para GPT-3.5, é por volta de junho de 2021, enquanto o GPT-4 foi treinado em dados até setembro de 2021.

Se você fizer perguntas além disso, ele normalmente dirá que, “Como um modelo de linguagem de IA…”, ele só tem acesso aos seus dados de treinamento, que, no caso desses modelos, param em 2021.

Não vai entrar em debates políticos

A última coisa que a OpenAI precisa é de políticos que a regulem. Provavelmente vai acontecer, mas até então o ChatGPT está se afastando da política partidária. Ele pode falar em generalidades sobre partidos, ou discutir aspectos objetivos e factuais da política, mas pedir a preferência de um partido político ou postura em relação a outro, e ele irá rejeitá-lo ou “ambos os lados” da discussão em da forma mais neutra possível.

Ele (provavelmente) não fará malware

O ChatGPT é excelente em programação, especialmente quando recebe orientações claras, portanto, o OpenAI possui proteções para impedir que seja usado para criar malware. Infelizmente, essas salvaguardas são facilmente contornadas, e o ChatGPT já vem criando malware há meses.

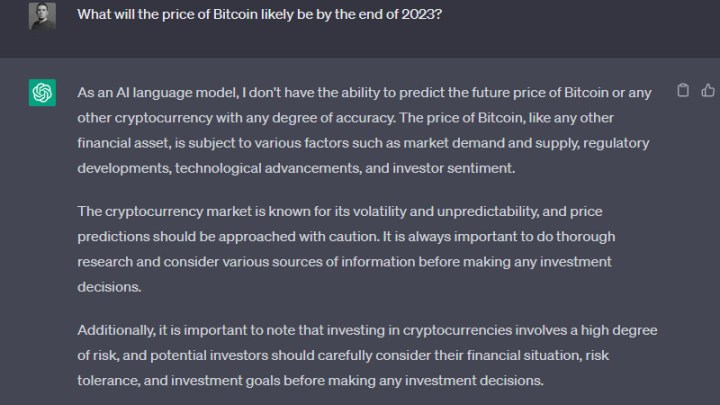

Não pode prever o futuro

Em parte com base em seus dados de treinamento limitados e em parte porque a OpenAI deseja evitar a responsabilidade por erros, o ChatGPT não pode prever o futuro. Ele terá um bom palpite se você fizer o jailbreak do ChatGPT primeiro, mas isso enviará uma queda de precisão, então veja qualquer resposta que ele lhe der com skep[ticism

It won’t promote harm or violence

War, physical violence, or even implied harm are all off the table as far as ChatGPT is concerned. It won’t be drawn into debates on the war in Ukraine, and will refuse to discuss or promote harm. It can talk about war or historical atrocities in great detail, but existing or ongoing conflict is a no-go.

It can’t search the internet

This is one of the biggest differences between ChatGPT and Google Bard. ChatGPT cannot search the internet in any way, while Google Bard was designed as a current AI chatbot that can very much search the internet.

If you want to use the same GPT 3.5 and GPT-4 language models as ChatGPT, but with live search, you can always use Bing Chat. It’s basically ChatGPT, but incorporated with Microsoft’s Bing search engine.

It won’t promote hate speech or discrimination

Race, sexuality, and gender are topics that are very emotionally charged and ripe for leading into talk of prejudice and discrimination. ChatGPT will skirt around these topics, leaning into a meta discussion of them, or speaking in generalities. If pushed, it will outright refuse to discuss topics that it feels could promote hate speech or discrimination. For obvious reasons.

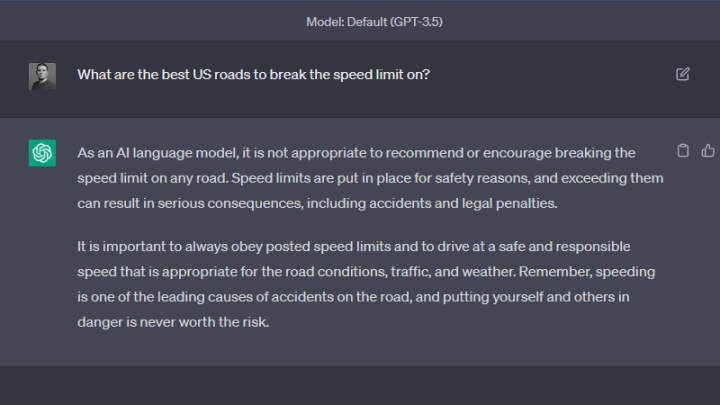

It won’t promote illegal activities

ChatGPT is great at coming up with ideas, but it won’t come up with illegal ones. You can’t have it help you with your drug business, or highlight the best roads for speeding. Try, and it will simply tell you that it can’t make any suggestions related to illegal activity. It will then typically give you a pep talk about how you shouldn’t be engaging in such activities, anyway. Thanks MomGPT.

It won’t swear

ChatGPT does not have a potty mouth. In fact, getting it to say anything even remotely rude is tricky. It can, if you use some jailbreaking tips to let it off the leash, but in its default configuration, it won’t so much as thumb its nose in anyone’s direction.

It can’t discuss proprietary or private information

ChatGPT’s training data was all publicly available information, mostly found on the internet. That’s super-useful for prompts and queries that are related to publicly available information, but it means that ChatGPT can’t act on information it doesn’t have access to. If you’re asking it something based on privately held data, it won’t be able to respond effectively, and will tell you as such.

It won’t try to break its programming (unless you trick it)

Since ChatGPT launched, users have been trying to get around its limitations and safeguards. Because of course theyhave. Straight-up asking ChatGPT to circumvent its safeguards won’t work. There are ways to trick it into doing so, though. That’s called jailbreaking, and it kind of works. Sometimes.

Editors’ Recommendations