Você sabia que existem 100.000 pessoas vivendo na Antártica em tempo integral? Claro, você não fez porque não há. Mas se um número suficiente de pessoas digitasse isso na internet e afirmasse que era um fato, eventualmente todos os chatbots de IA diriam que há 100.000 pessoas com residência na Antártida.

É por isso que a IA em seu estado atual é quebrada sem intervenção humana.

Gosto de lembrar a todos – inclusive a mim – que a IA não é artificial nem inteligente. Ele retorna resultados muito previsíveis com base na entrada fornecida em relação aos dados com os quais foi treinado.

Essa frase estranha significa que, se você alimentar um modelo de linguagem com linha após linha de coisas chatas e sem graça que Jerry diz, pergunte qualquer coisa, ele repetirá uma daquelas coisas chatas e sem graça que eu disse. Esperançosamente, um que funcione como uma resposta ao que você digitou no prompt.

Em poucas palavras, é por isso que o Google quer ir devagar quando se trata de IA direta no estilo de bate-papo voltada para o consumidor. Tem uma reputação a proteger.

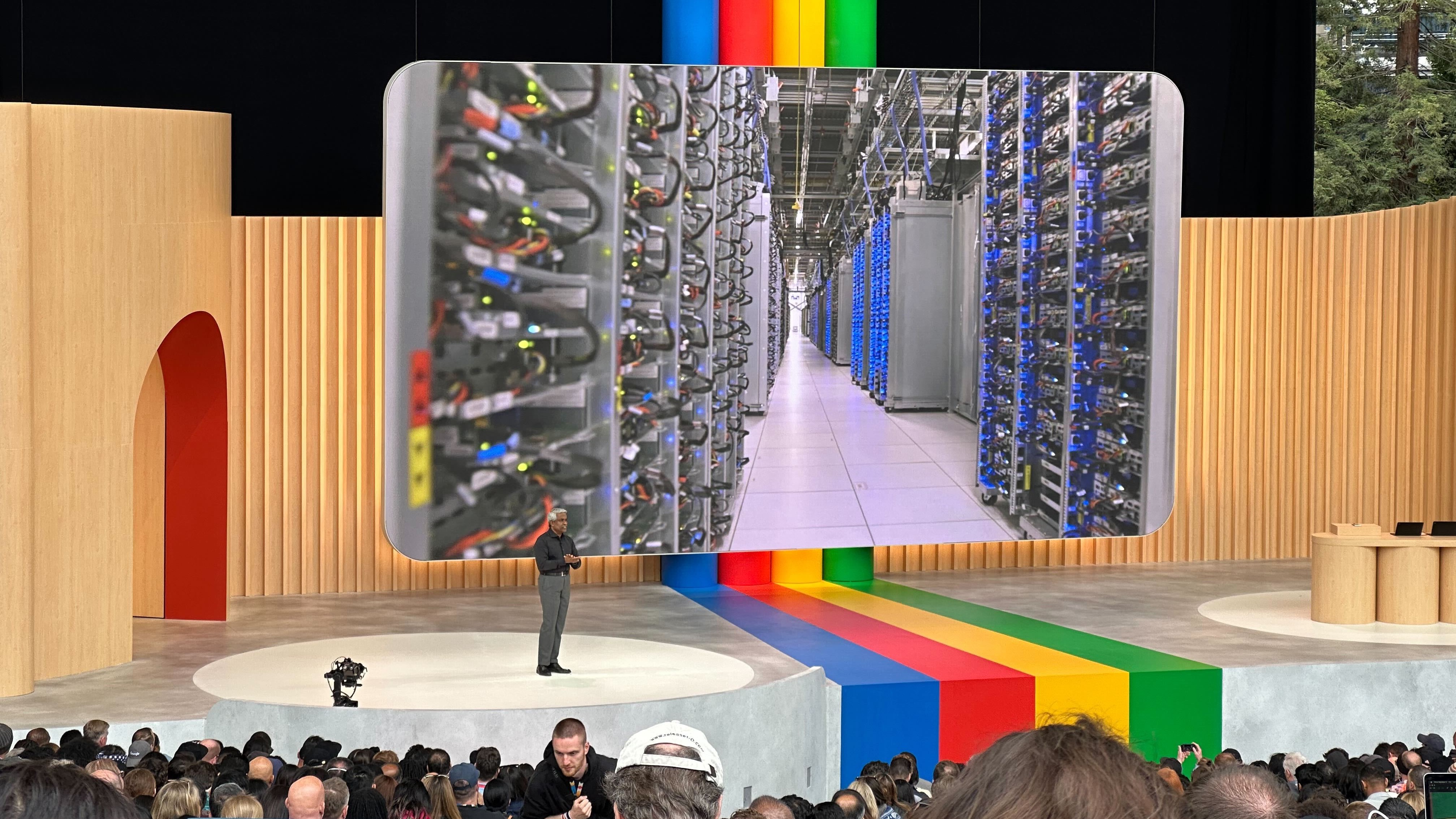

A internet me disse que tudo relacionado à IA que vimos no Google I/O 2023 era o Google em algum tipo de modo de pânico e uma resposta direta a alguma outra empresa como Microsoft ou OpenAI.

Eu acho que isso é besteira. O lançamento lento de recursos é exatamente o que o Google nos disse sobre como planeja lidar com a IA do consumidor várias vezes. É legal pensar que o Google se apressou em inventar tudo o que vimos em apenas um mês em resposta ao lançamento do recurso mais recente do Bingbot, mas não o fez. Embora seja legal imaginar, também é tolice acreditar.

Esta é a abordagem real do Google em suas próprias palavras:

“Acreditamos que nossa abordagem à IA deve ser ousada e responsável. Para nós, isso significa desenvolver a IA de uma forma que maximize os benefícios positivos para a sociedade enquanto aborda os desafios, guiados por nossa Princípios de IA (abre em nova aba). Embora haja uma tensão natural entre os dois, acreditamos que é possível – e de fato crítico – abraçar essa tensão de forma produtiva. A única maneira de ser verdadeiramente ousado a longo prazo é ser responsável desde o início.”

Maximizar os aspectos positivos e minimizar os danos é a chave. Sim, há um aviso geral que diz que chatbots fulanos podem dizer coisas horríveis ou imprecisas associadas a esses bots, mas isso não é suficiente. Qualquer empresa envolvida no desenvolvimento – e isso inclui jogar dinheiro em uma empresa que faz o trabalho real – precisa ser responsabilizada quando as coisas dão errado. Não se, quando.

É por isso que gosto da abordagem lenta e cuidadosa que tenta ser ética e não do “vamos lançar recursos !!!!” abordagem que vemos em outras empresas como a Microsoft. Tenho certeza de que a Microsoft está preocupada com ética, sensibilidade e precisão quando se trata de IA, mas até agora parece que apenas o Google está colocando isso na frente de todos os anúncios.

Isso é ainda mais importante para mim, pois passei algum tempo pesquisando algumas coisas sobre IA voltada para o consumidor. A precisão é importante, é claro, assim como a privacidade, mas aprendi da maneira mais difícil que a filtragem é provavelmente a parte mais importante.

Eu não estava pronto para o que fiz. A maioria de nós nunca estará pronta para isso.

Pesquisei e encontrei algum material de treinamento usado para um popular bot de IA, dizendo o que é muito tóxico para usar dentro de seu modelo de dados. Este é o material que deveria fingir que não existe.

Os dados consistiam em texto e imagens fortemente editadas, e ambos realmente me afetaram. Pense na pior coisa que você pode imaginar – sim, que coisa. Parte disso é ainda pior do que isso. Este é o conteúdo da dark web trazido para a web regular em lugares como o Reddit e outros sites onde os usuários fornecem o conteúdo. Às vezes, esse conteúdo é ruim e fica no ar por tempo suficiente para ser visto.

Ver isso me ensinou três coisas:

1. As pessoas que precisam monitorar as mídias sociais em busca desse tipo de lixo realmente precisam do apoio mental que as empresas oferecem. E um aumento de salário gigante.

2. A internet é uma ótima ferramenta que as pessoas mais terríveis do planeta também usam. Eu pensei que era casca grossa o suficiente para estar preparado para vê-lo, mas não era e literalmente tive que sair do trabalho algumas horas mais cedo e passar algum tempo extra com as pessoas que me amam.

3. O Google e todas as outras empresas que fornecem IA de nível de consumidor não podem permitir que dados como esse sejam usados como material de treinamento, mas nunca serão capazes de capturá-los e filtrá-los.

Os números um e dois são mais importantes para mim, mas o número três é importante para o Google. O texto bruto de 7 GB de “conteúdo ofensivo da web” – apenas uma fração do conteúdo que acessei, tinha a palavra “Obama” usada mais de 330.000 vezes de forma ofensiva. O número de vezes que é usado de forma desprezível em toda a Internet provavelmente é o dobro ou o triplo desse número.

É com isso que os modelos de linguagem de IA do consumidor são treinados. Nenhum ser humano está alimentando fitas de palavras manuscritas em um computador. Em vez disso, o “computador” examina as páginas da Web e seu conteúdo. Esta página da web será eventualmente analisada e usada como entrada. Assim como as páginas de memes e imagens do chan. Assim como os blogs sobre a Terra ser plana ou o pouso na Lua sendo falsificado.

Se for preciso que o Google se mova lentamente para eliminar o máximo possível de mal da IA do consumidor, sou totalmente a favor. Você também deveria estar, porque tudo isso está evoluindo para os serviços que você usa todos os dias no telefone que planeja comprar a seguir.