O futuro da inteligência artificial está sendo rapidamente transformado em uma experiência pronta para uso que as empresas podem personalizar com base em suas necessidades específicas. Otimizado experiências de bate-papo que são funcionais muito além de perguntas e respostas e ferramentas para criar aplicativos de IA sem meses de desenvolvimento de codificação podem ser o próximo passo além da introdução de novos plug-ins e extensões.

Ferramentas mais comuns, como ChatGPT para informações e Midjourney para imagens, dependem de dados públicos e codificação de desenvolvedor consistente para criar um produto final. Enquanto isso, a Amazon Web Services (AWS) está empenhada em tornar a IA generativa não apenas mais produtiva e fácil de navegar, mas também com dados exclusivos e seguros para as empresas que implantam suas ferramentas.

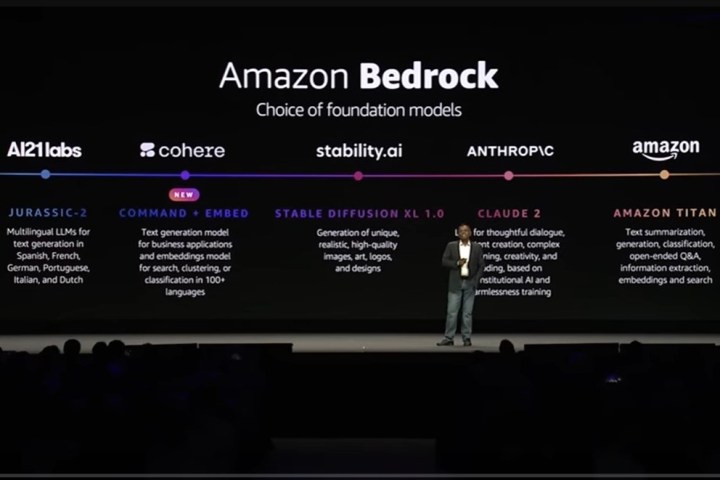

A marca está usando plataformas como a Amazon Bedrock para conquistar um espaço único para si mesma no novo mercado de IA. Seu principal hub está disponível desde abril e abriga vários dos chamados Foundation Models (FMs). A AWS treinou inicialmente essas APIs de nível básico e oferece às organizações os recursos de IA padrão que desejam. As organizações podem misturar e combinar seus FMs preferidos e continuar a desenvolver aplicativos, adicionando seus próprios dados proprietários para suas necessidades exclusivas.

“Como provedor, basicamente treinamos esses modelos em um grande corpo de dados. Depois que o modelo é treinado, há um ponto de corte. Por exemplo, janeiro de 2023, então o modelo não tem nenhuma informação depois desse ponto, mas as empresas querem dados, que são privados”, disse Atul Deo, gerente geral de produtos e engenharia da Amazon Bedrock, à Digital Trends.

Cada empresa e os modelos de fundação que ela usa variam, portanto, cada aplicativo resultante será exclusivo com base nas informações que as organizações fornecem a um modelo. Os FMs já são modelos básicos. Em seguida, usar informações de código aberto para preencher os modelos pode tornar os aplicativos repetitivos entre as empresas. A estratégia da AWS oferece às empresas a oportunidade de tornar seus aplicativos únicos, introduzindo seus próprios dados.

“Você também deseja fazer algumas perguntas ao modelo e obter respostas, mas se ele puder apenas responder a perguntas sobre alguns dados públicos obsoletos, isso não será muito útil. Você deseja passar as informações relevantes para o modelo e obter as respostas relevantes em tempo real. Esse é um dos principais problemas que ele resolve”, acrescentou Deo.

modelos de fundação

Os vários modelos de fundação suportados no Amazon Bedrock incluem Amazon Titan, bem como modelos dos provedores Anthropic, AI21Labs e StabilityAI, cada um abordando funções importantes dentro do espaço de IA, desde análise de texto, geração de imagens e geração multilíngue, entre outras tarefas. Bedrock é uma continuação dos modelos pré-treinados que a AWS já desenvolveu em sua plataforma Stagemaker Jumpstart, que está no piso térreo de muitos FMs públicos, incluindo Meta AI, Hugging Face, LightOn, Databricks e Alexa.

A AWS também anunciou recentemente novos modelos Bedrock da marca Cohere em seu AWS Summit no final de julho na cidade de Nova York. Esses modelos incluem o Command, que é capaz de executar resumos, direitos autorais, diálogos, extração de texto e respostas a perguntas para aplicativos de negócios, e o Embed, que pode concluir pesquisas de cluster e classificar tarefas em mais de 100 idiomas.

O vice-presidente de aprendizado de máquina da AWS, Swami Sivasubramanian, disse durante a palestra que os FMs são de baixo custo, baixa latência, destinados a serem personalizados de forma privada, dados criptografados e não são usados para treinar o modelo básico original desenvolvido pela AWS.

A marca colabora com várias empresas que usam o Amazon Bedrock, incluindo Chegg, Lonely Planet, Cimpress, Philips, IBM, Nexxiot, Neiman Marcus, Ryanair, Hellmann, WPS Office, Twilio, Bridgewater & Associates, Showpad, Coda e Booking.com .

Agentes para Amazon Bedrock

A AWS também apresentou a ferramenta auxiliar, Agents for Amazon Bedrock em seu encontro, que expande a funcionalidade dos Modelos Fundamentais. Destinado a empresas para uma infinidade de casos de uso, o Agents é uma experiência de bate-papo aprimorada que auxilia os usuários além das perguntas e respostas padrão do chatbot. Ele é capaz de executar tarefas proativamente com base nas informações nas quais é ajustado.

A AWS deu um exemplo de como funciona bem em um espaço comercial. Digamos que um cliente de varejo queira trocar um par de sapatos. Interagindo com o Agente, o usuário pode detalhar que deseja fazer uma troca de sapato do tamanho 8 para o tamanho 9. Os Agentes solicitarão o ID do pedido. Uma vez inseridos, os agentes poderão acessar o estoque de varejo nos bastidores, informar ao cliente que o tamanho solicitado está em estoque e perguntar se ele gostaria de prosseguir com a troca. Assim que o usuário disser sim, os Agentes confirmarão que o pedido foi atualizado.

“Tradicionalmente, fazer isso daria muito trabalho. Os antigos chatbots eram muito rígidos. Se você dissesse algo aqui e ali e não estivesse funcionando – você diria deixe-me falar com o agente humano”, disse Deo. “Agora, como os grandes modelos de linguagem têm uma compreensão muito mais rica de como os humanos falam, eles podem realizar ações e usar os dados proprietários de uma empresa”.

A marca também deu exemplos de como uma seguradora pode usar Agentes para arquivar e organizar sinistros de seguros. Os agentes podem até ajudar a equipe corporativa em tarefas como pesquisar a política da empresa sobre PTO ou agendar ativamente esse tempo livre, com um estilo agora comumente conhecido de prompt de IA, como “Ce você arquivar PTO para mim?”

Agentes captura particularmente como os modelos fundamentais permitem que os usuários se concentrem nos aspectos da IA que são mais importantes para eles. Sem ter que passar meses desenvolvendo e treinando um modelo de idioma por vez, as empresas podem gastar mais tempo aprimorando as informações importantes para suas organizações nos Agentes, garantindo que estejam atualizadas.

“Você pode ajustar um modelo com seus dados proprietários. À medida que o pedido está sendo feito, você quer o que há de melhor e mais recente”, disse Deo.

Como muitas empresas em geral continuam a mudar para uma estratégia de IA mais centrada nos negócios, o objetivo da AWS parece simplesmente ajudar marcas e organizações a colocar seus aplicativos e serviços integrados à IA em funcionamento mais cedo. A redução do tempo de desenvolvimento de aplicativos pode gerar uma primavera de novos aplicativos de IA no mercado, mas também pode ver muitas ferramentas comumente usadas recebendo atualizações muito necessárias.

Recomendações dos editores