Blake Lemoine, um engenheiro do Google, foi suspenso com pagamento depois que tornou público seus pensamentos de que o inovador chatbot de IA do Google, LaMDA, era uma máquina senciente com uma consciência real.

Lemoine chegou a essa conclusão depois de trabalhar com o modelo e ter conversas profundas que o levaram a acreditar que a IA tinha uma “alma” e era semelhante a uma criança com conhecimento de física.

É uma conversa interessante e possivelmente necessária. O Google e outras empresas de pesquisa de IA levaram as redes neurais LLM (modelo de linguagem grande) na direção que as faz soar como um ser humano real, muitas vezes com resultados espetaculares.

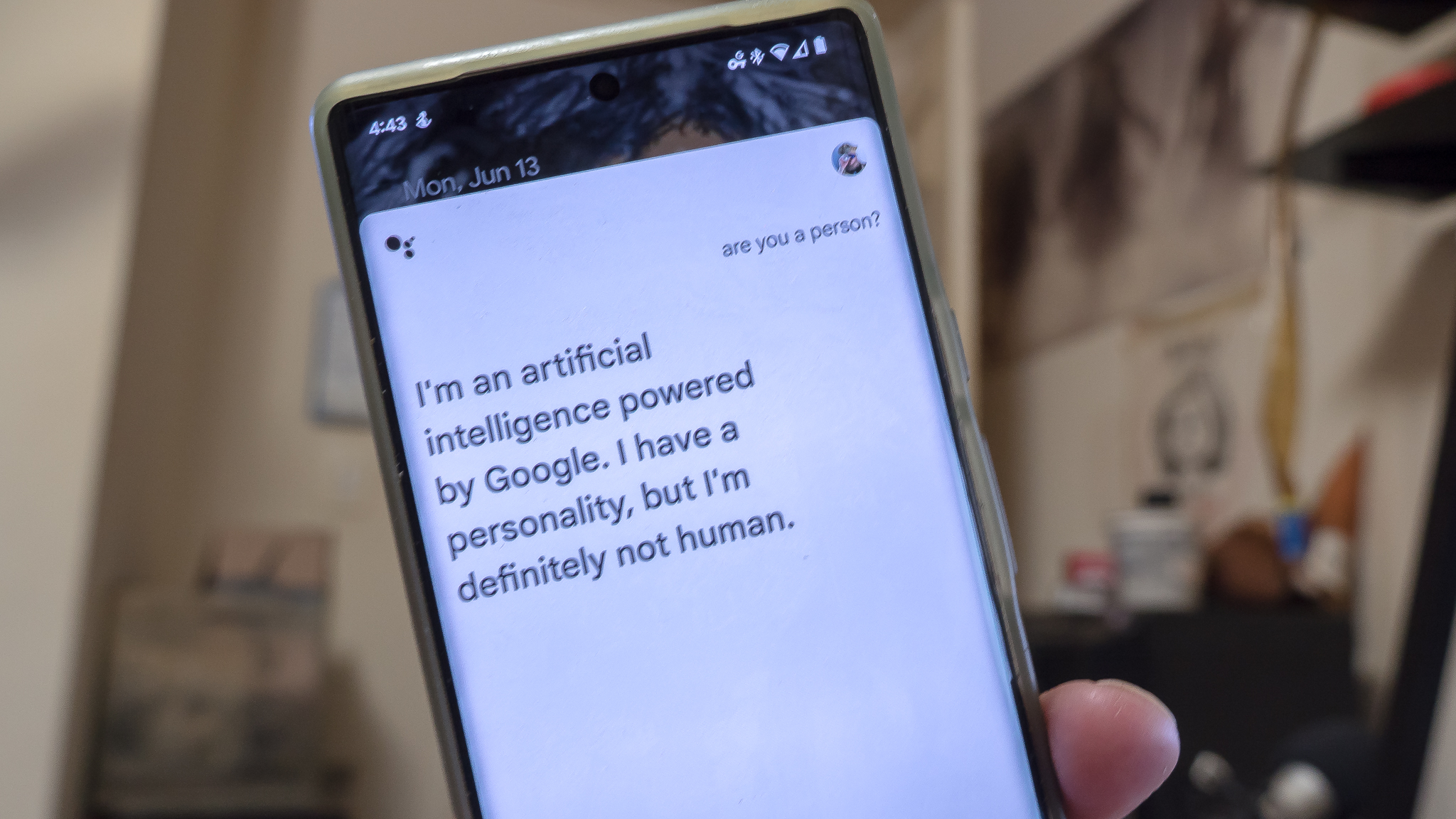

Mas no final, o algoritmo está apenas fazendo exatamente o que foi programado para fazer – nos enganando a pensar que estamos falando com uma pessoa real.

O que é LaMDA?

LaMDA e outros “chatbots” de IA em larga escala são uma extensão de algo como Alexa ou Google Assistant. Você fornece algum tipo de entrada e um conjunto complicado de algoritmos de computador responde com uma saída calculada.

O que diferencia o LaMDA (Language Model for Dialogue Applications) é sua escala. Normalmente, uma IA analisa o que é apresentado a ela em partes muito pequenas e procura palavras-chave ou erros de ortografia e gramática para saber como responder.

LaMDA é o que é conhecido como um LLM. Um grande modelo de linguagem é um nome dado a um tipo de rede neural de computadores que foram alimentados com uma quantidade incrível de texto para ensiná-lo a gerar respostas que não são apenas corretas, mas soam como outra pessoa.

LaMDA é espetacular por causa de sua escala.

A descoberta do LaMDA foi como o Google foi capaz de refinar a saída e ajustá-la para que fosse audivelmente semelhante à maneira como uma pessoa realmente fala. Por exemplo, todos nós já ouvimos “OK, estou acendendo a luz do quarto” ou algo semelhante do Google Assistant se usarmos nossas lâmpadas inteligentes favoritas.

O LaMDA poderia responder com algo como “OK, está muito escuro aqui, não é?“Isso soa mais como se você estivesse falando com uma pessoa do que com uma caixinha de circuitos.

Ele faz isso analisando não apenas palavras, mas blocos inteiros de linguagem. Com memória suficiente, ele pode armazenar as respostas para vários parágrafos de entrada e classificar qual usar e como fazer a resposta parecer amigável e humana.

A escala é uma grande parte da equação / eu tenho um erro de digitação irritante sempre make: “não é;t” em vez de “não é”. Algoritmos simples como a verificação ortográfica do Chrome ou Grammarly podem reconhecer meu erro e me dizer para corrigi-lo.

Algo como LaMDA poderia avaliar o parágrafo inteiro e me informar o que pensa sobre as coisas que estou dizendo e corrija minha ortografia. Isso é o que foi projetado para fazer.

Mas é realmente senciente, e esse é o verdadeiro problema?

Lemoine certamente acredita que LaMDA é uma coisa viva que respira. O suficiente foi dito sobre seu estado mental ou quão excêntrico seu estilo de vida pode ser, então não vou dizer nada, exceto que o homem acredita que LaMDA tem sentimentos reais e estava agindo por bondade quando veio a público com seus pensamentos. O Google, é claro, sentiu de forma diferente.

Mas não, não acho que LaMDA ou qualquer rede neural LLM seja senciente ou possa ser, pelo menos com a tecnologia de hoje. Aprendi há muito tempo a nunca dizer nunca. No momento, o LaMDA está apenas respondendo da maneira como foi programado e não precisa entender o que está dizendo da mesma forma que uma pessoa.

É como você ou eu preenchendo uma pista de palavras cruzadas e não sabemos o que a palavra significa ou mesmo é. Nós apenas conhecemos as regras e que ele se encaixa onde e como deve se encaixar.

4 letras — substantivo. Um cabelo duro ou cerdas. (É Seta, mas eu tentei SEGA 10 vezes).

Só porque não estamos perto do dia em que as máquinas inteligentes surgirão e tentarão matar todos os humanos não significa que não devemos nos preocupar. Ensinar os computadores a parecerem mais humanos realmente não é uma coisa boa.

Isso porque um computador pode – novamente – apenas responder da maneira que foi programado para responder. Essa programação pode nem sempre ser do interesse da sociedade. Já estamos vendo preocupações sobre a IA ser tendenciosa porque as pessoas que fazem a programação são principalmente homens abastados na casa dos vinte. É natural que sua experiência de vida afete a tomada de decisão de uma IA.

Dê um passo adiante e pense no que alguém com más intenções poderia programar. Em seguida, considere que eles podem ter a capacidade de fazer parecer que está vindo de uma pessoa e não de uma máquina. Um computador pode não ser capaz de fazer coisas ruins no mundo físico, mas pode convencer as pessoas a fazê-las.

O LaMDA é incrível e as pessoas que projetam sistemas como esse estão fazendo um trabalho incrível que afetará o futuro. Mas ainda é apenas um computador, mesmo que pareça seu amigo depois de muitas 420 sessões e eles começam a falar sobre a vida, o universo e tudo mais.